近日,南京信息工程大学智能医学图像计算江苏高校重点实验室(IMIC)宣锴课题组在国际期刊 IEEE Journal of Biomedical and Health Informatics (JBHI)上发表了最新研究成果。该研究题为 Hybrid Multi-View MRI Fusion for csPCa Diagnosis via Intra- and Inter-View Transformers(基于视图内与视图间Transformer的临床显著前列腺癌多视图MRI融合方法),为前列腺癌的早期精准筛查与临床辅助诊断提供了全新的思路和技术支撑。

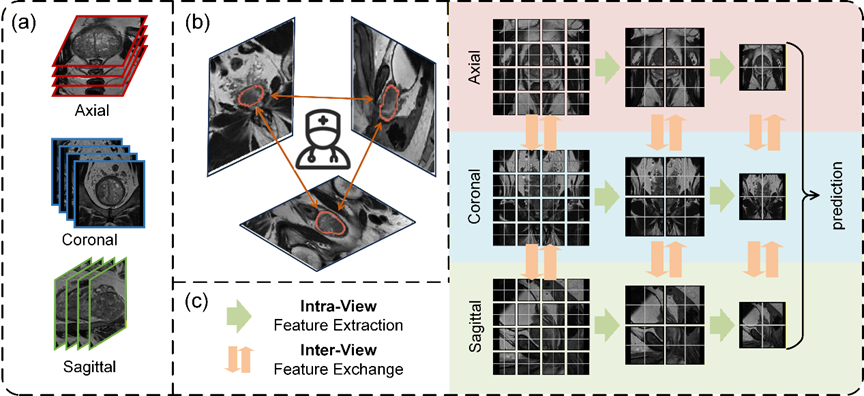

在临床显著前列腺癌(csPCa)的诊断中,前列腺核磁共振成像通常包含轴向、冠状和矢状三个视图。不同视图在病灶形态与空间分布上存在显著差异,能够提供极具价值的互补诊断信息。在实际临床实践中,放射科医生往往需要综合这三个视图进行联合判读,以更全面地识别病灶。然而,单一视图包含的信息相对不足,而现有的多视图融合算法又面临着难以同时兼顾跨视图空间对应关系与模型计算效率的核心痛点。

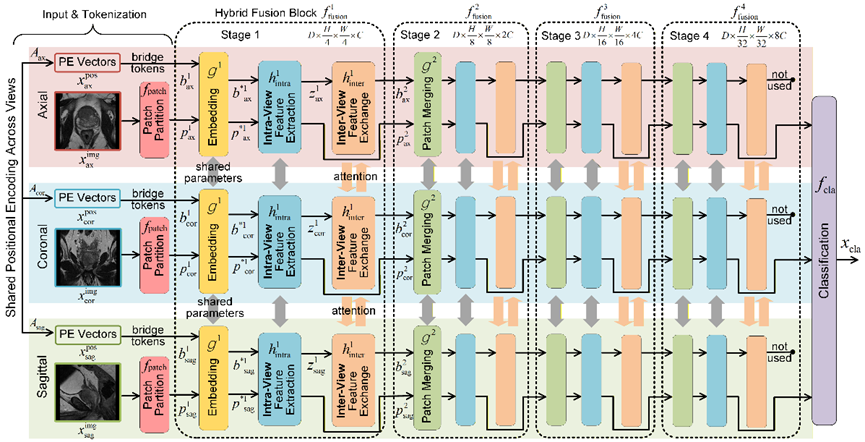

基于上述临床与技术痛点,宣锴课题组提出了一种全新的多视图混合融合模型。该研究创新性地将多视图信息的融合拆分为视图内特征提取和视图间特征交换两个核心模块,并通过多分辨率迭代实现逐步、深度的融合。在视图内层面,模型基于3D Swin Transformer高效提取局部结构特征,并引入桥接标记在局部窗口内快速汇聚上下文信息,从而打牢局部特征基础。

在视图间层面,该模型利用Vision Transformer和桥接标记(bridge tokens),实现了不同解剖平面之间的全局信息高效交换,建立起精准的跨视图空间对应关系。同时,模型引入了共享位置编码,使得不同视图能够在统一的解剖参考空间中进行对齐。这不仅进一步增强了跨视图的注意力机制与空间一致性,也实现了三视图信息的协同建模与高效利用。

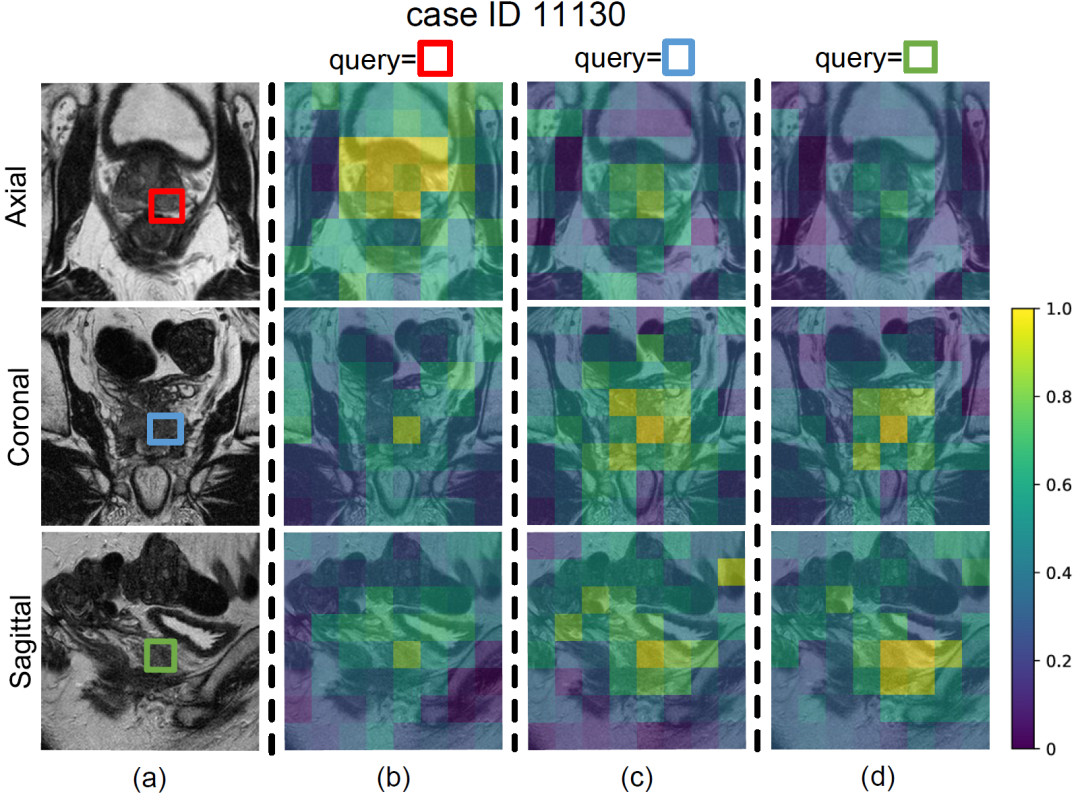

为了验证该模型的有效性,研究团队在公开数据集PI-CAI上进行了详尽的测试。实验结果表明,该模型取得了优异的诊断表现,准确率达到0.766,曲线下面积达到0.785,整体性能显著优于当前多种主流的多视图融合方法。此外,丰富的消融实验与注意力可视化分析进一步验证了视图间特征交换模块与共享位置编码的有效性和关键作用。

该研究在保证较高分类性能的同时,也兼顾了计算效率,为前列腺MRI的临床辅助诊断提供了更稳健、更具可解释性的技术支撑。这一成果有望在未来帮助放射科医生更准确地识别csPCa,进一步推动早期筛查与精准诊疗的发展。

本文引用方式与原文链接

Y. Zhao, D. Li, T. Zhang, X. Wang, J. Xu and K. Xuan, "Hybrid Multi-View MRI Fusion for csPCa Diagnosis via Intra- and Inter-View Transformers," in IEEE Journal of Biomedical and Health Informatics, doi: 10.1109/JBHI.2026.3672887.